QuickQ通过在客户端与目标容器仓库之间建立高质量的智能加速通道,结合全球节点路由优化、边缘缓存与协议优化(比如并发分层传输、TLS会话复用、QUIC/UDP加速等),降低延迟、减少丢包并提高带宽利用率,从而显著缩短镜像拉取和推送时间,适用于开发、CI/CD、Kubernetes节点与企业自建仓库的加速场景。

先把问题拆开——为什么要给容器仓库加速?

嗯,容器镜像看起来只是“文件”,但真实场景复杂得多:镜像通常由许多层组成、从远端仓库拉取会受到跨境延迟、丢包、带宽限制和远程限流影响。CI/CD流水线、集群扩容、远程开发和多地域部署都会频繁拉镜像,几秒钟变成几分钟,严重影响效率。

关键痛点

- 高延迟:跨境或长距离连接,握手与TCP慢启动增加时间。

- 丢包与抖动:丢包会导致重传,影响大文件传输效率。

- 带宽不稳定:上行/下行限制、流量控制或ISP峰值时段抑制。

- 并发与限速:远端仓库对单IP有限制,CI并行拉取时容易触发限流。

- 缓存缺失:同一层在不同地域重复下载,浪费时间和带宽。

QuickQ如何“物理上”去加速镜像拉取/推送?

想象QuickQ像一条更顺、更快的高速带,它不是改仓库本身,而是在你和仓库之间做路由与优化。下面我把具体手段拆成几块,方便理解与落地。

1. 智能路由与全球节点加速

QuickQ在全球部署多个加速节点(edge/POP),当你访问某个容器仓库时,客户端会自动选择最优节点,建立加速通道,再由该节点与目标仓库通信。重点是:

- *最短路径选择*:避免跨国劣质链路,减少往返时间(RTT)。

- *多路径与故障切换*:遇到拥塞自动切换到备用路径,保证稳定性。

2. 边缘缓存与镜像代理(Registry Proxy / Mirror)

把常用镜像的层缓存在靠近用户的节点上,就像高速公路旁多了直接能下的服务区。效果:同地域或同网络内的节点拉取时直接命中边缘缓存,真正省时间和带宽。

- 可配置为镜像仓库镜像(registry mirror)或代理模式,支持Docker Registry v2、Harbor、Docker Hub、GCR、ECR等。

- 对CI缓存非常友好,可显著降低对上游的请求频率,避免触发上游限速。

3. 协议层优化(TCP优化、QUIC、并发传输)

文件传输不是看带宽就完了,协议效率很重要。QuickQ在通道上做了若干优化:

- TCP参数调优:拥塞控制、窗口扩大、快速重传策略。

- 支持QUIC/UDP加速:对高丢包链路更友好,减少握手延迟。

- 并发分块下载:把大层划分为多个并行块同时拉取,加快总时长。

4. TLS会话复用与连接复用

每次建立TLS握手都要花时间,QuickQ通过会话复用、长连接维护与HTTP/2或HTTP/3复用减少握手次数,特别在频繁请求registry的场景里很明显。

5. DNS加速与智能解析

拉镜像前会做域名解析,Smart DNS能把仓库域名解析到最近的加速节点或最优出口,避免解析到远端真实IP直接走慢路径。

6. 并发节流与分布式限流策略

当CI并发量大时,QuickQ可以在本地节点做并发控制或按项目做队列,平滑地把请求推到上游,避免瞬时并发触发上游限速。

实际部署场景与配置指南(落地步骤)

好,理论有用了,但你要能放到生产环境里。我把常见场景分开写,越具体越好,顺序按从小到大:开发者本机 -> CI runner/构建节点 -> Kubernetes集群/边缘节点 -> 企业自建仓库。

场景一:开发者电脑或单机Docker

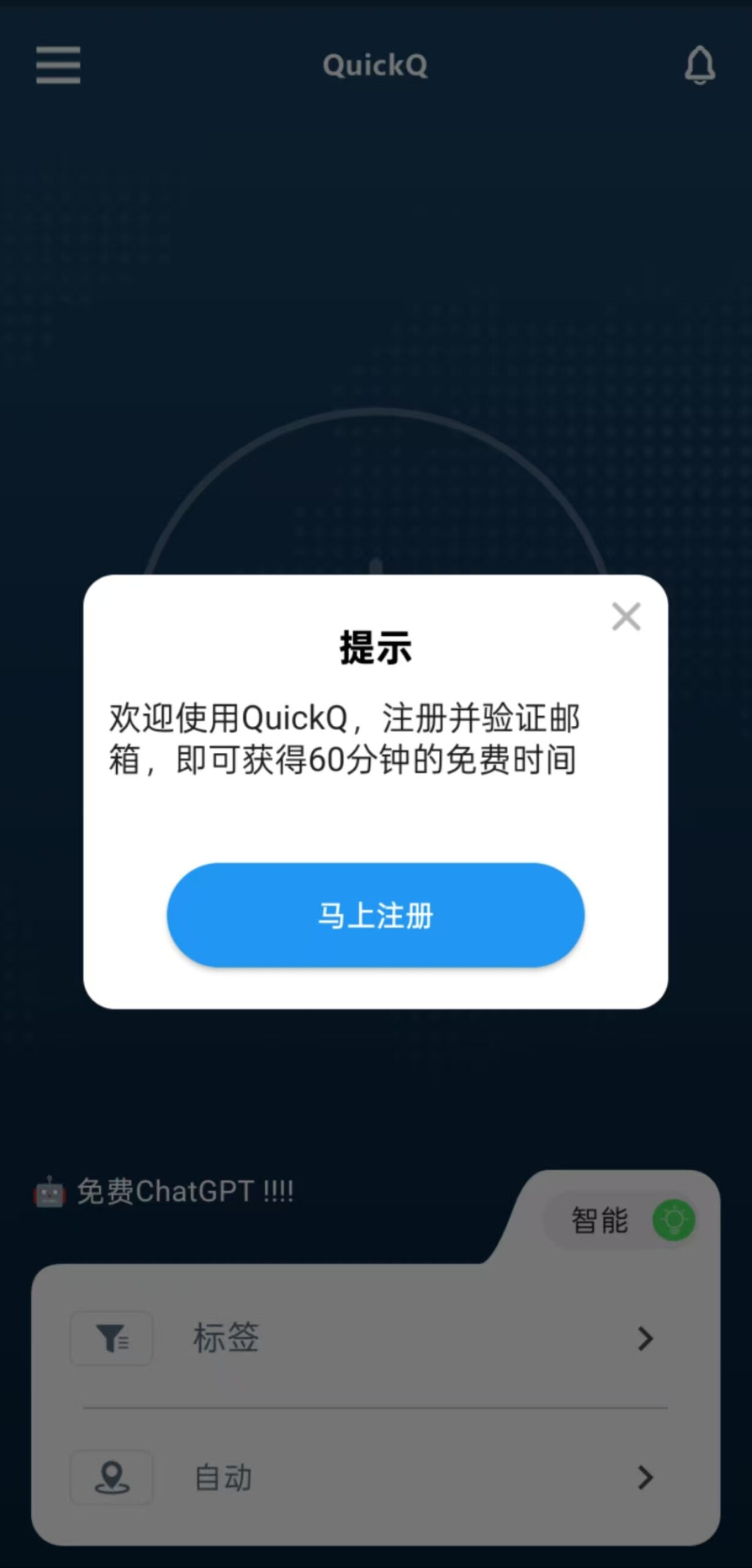

- 安装QuickQ客户端(Windows/macOS/Linux),启用系统代理或设置“应用直连”规则。

- 用QuickQ把访问目标仓库的流量走加速通道,确保Docker进程走系统网络或配置HTTP(S)_PROXY环境变量。

示例(Linux/Bash):

export HTTP_PROXY=http://127.0.0.1:1080 export HTTPS_PROXY=http://127.0.0.1:1080 docker pull registry.example.com/myapp:latest

或者在Docker Desktop里把“Use system proxy”打开(视客户端而定)。如果QuickQ作为虚拟网卡存在,Docker会直接通过该网卡走加速。

场景二:CI/CD Runner(比如GitLab Runner / GitHub Action自托管)

CI节点常常是拉镜像的高频场景,关键目标是:把镜像缓存靠近Runner,避免每次都走跨境链路。

- 本地边缘缓存:在同机或同VPC上运行一个Registry Mirror,镜像初次从上游拉取并缓存。

- 配合QuickQ:让Runner访问上游仓库的链路通过QuickQ节点,以便更快完成初次缓存。

在Docker daemon配置镜像加速器(daemon.json):

{

"registry-mirrors": ["https://mirror.local"]

}

场景三:Kubernetes集群节点与集群级加速

集群扩容或节点启动时会并发拉取大量镜像,这时候效果最明显。

- Node级代理:在每个节点或每个子网部署QuickQ网关或Sidecar,使节点的containerd/docker流量走加速。

- 集群镜像代理:部署一个集群范围的registry-proxy(例如Harbor作为Pull Through Cache 或 nginx/registry作为缓存反代),并把kubelet/containerd配置指向该代理。

containerd配置示例(/etc/containerd/config.toml):

[plugins.cri.registry.mirrors."docker.io"] endpoint = ["https://mirror.local"]

别忘了重启containerd:systemctl restart containerd

场景四:企业自建仓库(对外/对内)

如果你维护自己的Registry(Harbor/Registry),可以使用QuickQ在两个方向做优化:

- 出口优化:仓库对外服务时,用QuickQ加速到全球节点,改善外部开发者或合作方的访问。

- 入口优化:构建/CI向仓库push镜像时,通过加速通道减少push耗时,尤其是大层或慢链路场景。

配置示例与命令汇总(常见工具)

列几个常用工具的配置片段,方便直接复制粘贴试用。

| 工具 | 配置/命令 |

| Docker(daemon.json) | {“registry-mirrors”: [“https://mirror.local”]} |

| containerd | [plugins.cri.registry.mirrors.”docker.io”] endpoint = [“https://mirror.local”] |

| 环境变量 | export HTTP_PROXY=…; export HTTPS_PROXY=… |

性能改善原理:把“为什么”说清楚

我想解释为什么这些措施有用,免得看着像魔术。核心其实是三件事:减少RTT、减少重传、提高并发吞吐。

- 减少RTT:智能节点让握手和首次请求走更短路径。

- 减少重传:更稳定链路和QUIC/UDP减少丢包造成的重传。

- 提高并发吞吐:并行下载、连接复用以及更合理的拥塞控制让带宽被更有效利用。

安全与合规要点(别忽视)

加速不能牺牲安全,以下是必须考虑的点:

- 确保TLS终端点和证书管理符合要求,若使用边缘缓存代理,要保证证书链和凭证安全。

- 敏感镜像(带密钥/凭证的镜像层)避免在公共边缘缓存中长期保存,或设置缓存策略和访问控制。

- 鉴权(token、基本认证)应通过安全通道转发并限制缓存可见性。

- 审计与日志:记录pull/push事件以便追踪与合规。

常见问题与排障清单

遇到问题时,你可以按这个顺序排查:

- DNS解析:确认域名解析到QuickQ或预期IP。

- 代理/环境变量:检查HTTP(S)_PROXY是否生效,Docker是否使用系统代理。

- 证书错误:边缘代理证书是否信任,是否需要把CA加入信任链。

- MTU与分片:如果加速通道涉及隧道封装,MTU不匹配会导致性能下降。

- 限速/配额:确认上游仓库是否对单IP限流,是否需要做多IP并发或镜像缓存策略。

不同加速策略的对比(一张小表)

| 策略 | 优点 | 缺点 |

| VPN/智能隧道 | 端到端加速、易部署 | 需全流量或规则设置,可能影响其他服务 |

| 边缘缓存/镜像代理 | 命中率高、节省带宽 | 首次拉取仍需上游、缓存一致性需考虑 |

| 上游仓库做CDN | 对大量分布式用户最佳 | 需仓库支持或付费,非自研可控 |

一些实用建议(经验之谈)

- 优先对高频镜像做缓存或镜像迁移,低频镜像不必全面缓存。

- 在CI里用“构建缓存镜像”和“层重用”策略,减少每次全量拉取。

- 对多地域团队,考虑局部镜像仓库+QuickQ做跨域同步。

- 监控:把拉取时延、命中率、失败率纳入指标,定期调整策略。

我刚把这些写完,顺手又想起一点:别把加速当作“一劳永逸”的配置,网络条件、仓库策略和团队使用习惯都会变,持续观测和调优才是关键。要是你想,我可以按你当前的部署环境(比如K8s + GitLab CI在某一区域)写一份具体可执行的配置清单和命令。就像做菜,配料和火候得对上才好吃——加速也是这个道理。